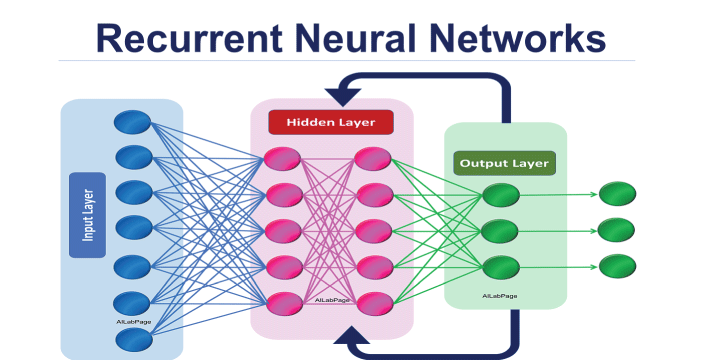

Recurrent Neural Network (RNN) adalah jenis arsitektur jaringan saraf yang dirancang untuk memproses data yang memiliki urutan, seperti teks, audio, atau data waktu. Dalam dunia kecerdasan buatan, RNN sangat penting karena kemampuannya untuk “mengingat” informasi dari input sebelumnya dan menggunakannya untuk memprediksi atau menganalisis data berikutnya dalam urutan tersebut.

Mengapa RNN Efektif dalam Mengolah Data Berurutan?

Salah satu keunggulan utama RNN adalah memori internalnya yang memungkinkan jaringan untuk menyimpan informasi dari waktu ke waktu. Ketika sebuah jaringan saraf standar (feedforward neural network) hanya memproses input secara langsung tanpa mempertimbangkan urutan data, RNN justru mempertimbangkan urutan tersebut. Ini membuat RNN sangat ideal untuk tugas-tugas yang memerlukan pemahaman konteks dalam sebuah rangkaian, seperti penerjemahan bahasa atau analisis sentimen dalam teks.

Contoh Penerapan RNN dalam Kehidupan Sehari-hari

RNN digunakan dalam berbagai aplikasi teknologi yang kita temui setiap hari. Contoh umum adalah prediksi teks di ponsel, di mana model RNN memprediksi kata berikutnya yang mungkin akan Anda ketik berdasarkan kata-kata sebelumnya. Selain itu, RNN juga digunakan dalam asisten virtual seperti Siri atau Google Assistant untuk memahami perintah suara dalam konteks yang lebih luas.

Tantangan dalam Penggunaan RNN

Meskipun RNN sangat kuat, mereka juga memiliki beberapa tantangan. Salah satunya adalah masalah “vanishing gradient,” di mana jaringan mengalami kesulitan dalam belajar hubungan jangka panjang dalam urutan data. Masalah ini dapat menghambat kinerja model saat menangani urutan data yang panjang. Namun, varian dari RNN seperti Long Short-Term Memory (LSTM) dan Gated Recurrent Unit (GRU) telah dikembangkan untuk mengatasi tantangan ini dengan lebih baik.

RNN vs. Teknik Pengolahan Data Lainnya

Ketika berbicara tentang pengolahan data berurutan, RNN sering dibandingkan dengan teknik lain seperti Transformer. Transformer juga dirancang untuk menangani urutan data, tetapi berbeda dalam cara mereka memproses informasi. Transformer menggunakan mekanisme perhatian yang memungkinkan model untuk fokus pada bagian-bagian penting dari urutan tanpa harus mengandalkan urutan kronologis. Dalam banyak kasus, Transformer telah mengungguli RNN dalam hal kecepatan dan akurasi, terutama dalam tugas-tugas seperti terjemahan bahasa.

Kesimpulan

Recurrent Neural Network memainkan peran penting dalam pengolahan data berurutan, terutama dalam aplikasi yang membutuhkan pemahaman kontekstual yang mendalam. Meskipun mereka memiliki tantangan, perkembangan teknik seperti LSTM telah memperkuat kemampuan RNN dalam memproses urutan data yang panjang dan kompleks. Dengan memahami cara kerja RNN, kita dapat lebih menghargai teknologi di balik banyak aplikasi cerdas yang kita gunakan setiap hari.

FAQ

1. Apa itu Recurrent Neural Network (RNN)? Recurrent Neural Network (RNN) adalah jenis arsitektur jaringan saraf yang dirancang untuk memproses data yang memiliki urutan, seperti teks, audio, atau data waktu. RNN dapat “mengingat” informasi dari input sebelumnya dan menggunakannya untuk memproses data berikutnya dalam urutan tersebut.

2. Apa keunggulan RNN dibandingkan dengan jaringan saraf standar? Keunggulan utama RNN adalah kemampuannya untuk mempertimbangkan urutan data. Jaringan saraf standar (feedforward neural network) hanya memproses input secara langsung tanpa mempertimbangkan urutan, sedangkan RNN menggunakan memori internal untuk mengingat dan memproses urutan data, yang sangat penting dalam tugas-tugas seperti analisis teks atau prediksi data waktu.

3. Dalam kasus apa RNN sering digunakan? RNN sering digunakan dalam aplikasi seperti prediksi teks, penerjemahan bahasa, analisis sentimen, pengenalan suara, dan pemrosesan video. Misalnya, RNN dapat digunakan untuk memprediksi kata berikutnya yang akan Anda ketik atau memahami perintah suara dalam konteks yang lebih luas.

4. Apa tantangan utama yang dihadapi RNN? Salah satu tantangan utama yang dihadapi RNN adalah masalah “vanishing gradient,” di mana jaringan mengalami kesulitan dalam belajar hubungan jangka panjang dalam urutan data. Ini dapat menghambat kinerja RNN dalam mengolah data yang memiliki urutan panjang.

5. Apa perbedaan antara RNN dengan Long Short-Term Memory (LSTM)? LSTM adalah varian dari RNN yang dirancang untuk mengatasi masalah vanishing gradient. LSTM menggunakan mekanisme khusus yang memungkinkan jaringan untuk “mengingat” informasi penting dalam urutan data lebih lama, sehingga lebih efektif dalam memproses data berurutan yang panjang.

6. Bagaimana RNN dibandingkan dengan teknik lain seperti Transformer? Transformer adalah teknik lain yang dirancang untuk menangani urutan data, tetapi menggunakan pendekatan yang berbeda. Transformer menggunakan mekanisme perhatian yang memungkinkan model untuk fokus pada bagian-bagian penting dari urutan tanpa harus mengandalkan urutan kronologis. Dalam banyak kasus, Transformer telah terbukti lebih cepat dan lebih akurat dibandingkan RNN, terutama dalam tugas-tugas seperti terjemahan bahasa.

7. Apakah RNN masih relevan dengan adanya Transformer? Meskipun Transformer telah menjadi sangat populer, RNN masih relevan dan digunakan dalam banyak aplikasi, terutama ketika urutan data yang pendek dan sederhana perlu diolah. Varian seperti LSTM dan GRU juga telah memperkuat posisi RNN dalam berbagai aplikasi canggih.

8. Apa peran RNN dalam kecerdasan buatan? RNN berperan penting dalam kecerdasan buatan, terutama dalam bidang pengolahan bahasa alami, pengenalan suara, dan analisis data waktu. Dengan RNN, sistem AI dapat memahami konteks dan urutan dalam data, yang penting untuk menghasilkan prediksi yang akurat dan relevan.

9. Bagaimana RNN mempengaruhi teknologi yang kita gunakan sehari-hari? RNN digunakan dalam berbagai teknologi yang kita gunakan sehari-hari, seperti aplikasi prediksi teks, asisten virtual, dan sistem rekomendasi. Kemampuan RNN untuk memahami dan memproses urutan data membuatnya menjadi komponen penting dalam banyak aplikasi cerdas.

10. Apakah RNN cocok untuk semua jenis data berurutan? RNN cocok untuk banyak jenis data berurutan, tetapi mungkin tidak selalu menjadi pilihan terbaik untuk data yang sangat panjang atau kompleks. Dalam kasus seperti itu, teknik seperti LSTM atau Transformer mungkin lebih efektif. Namun, RNN tetap menjadi pilihan kuat untuk banyak aplikasi, terutama yang membutuhkan pemahaman urutan dalam konteks yang lebih sederhana.